PÅ FARTEN? LYTT ELLER SE

Oppsummering

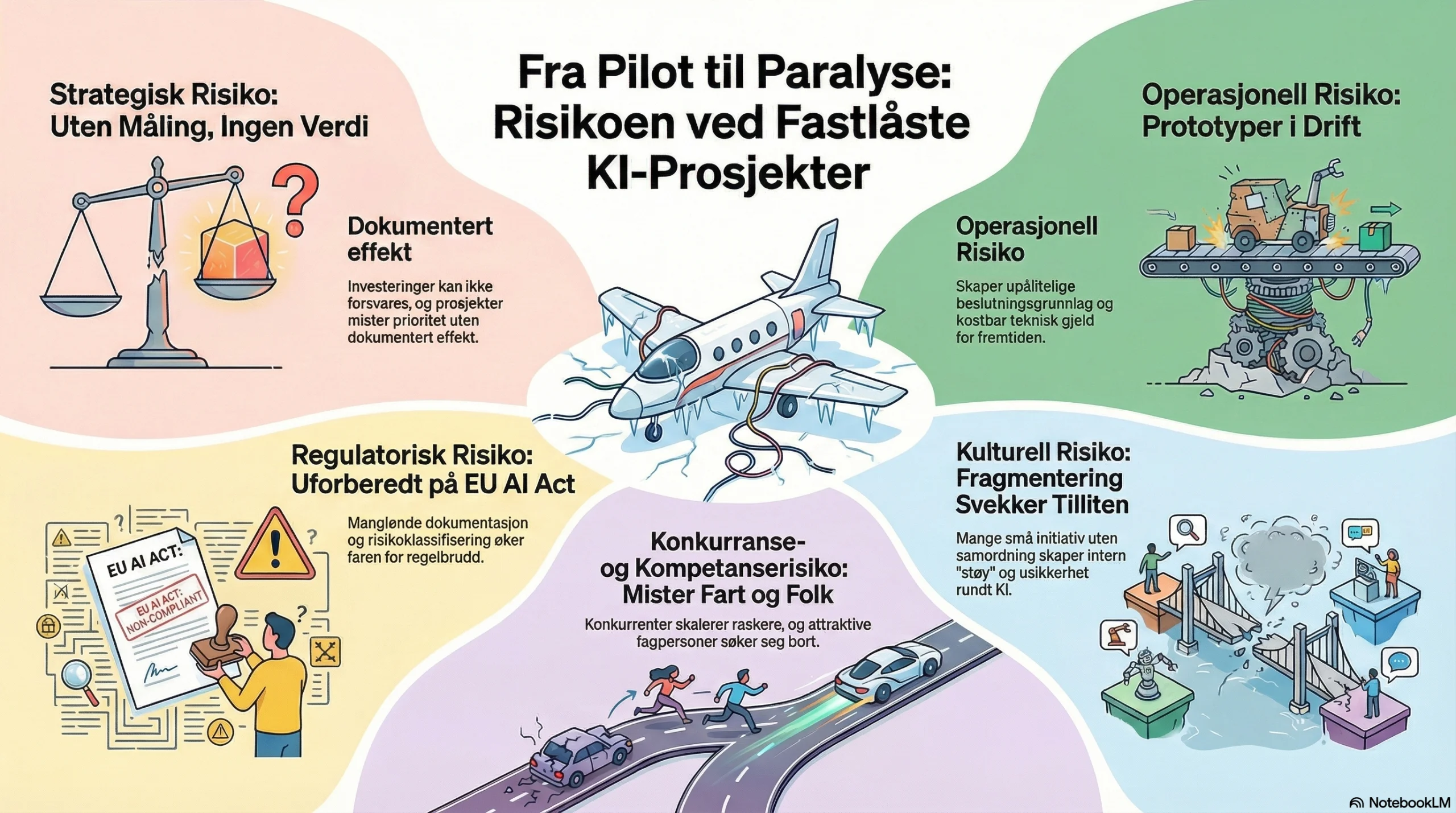

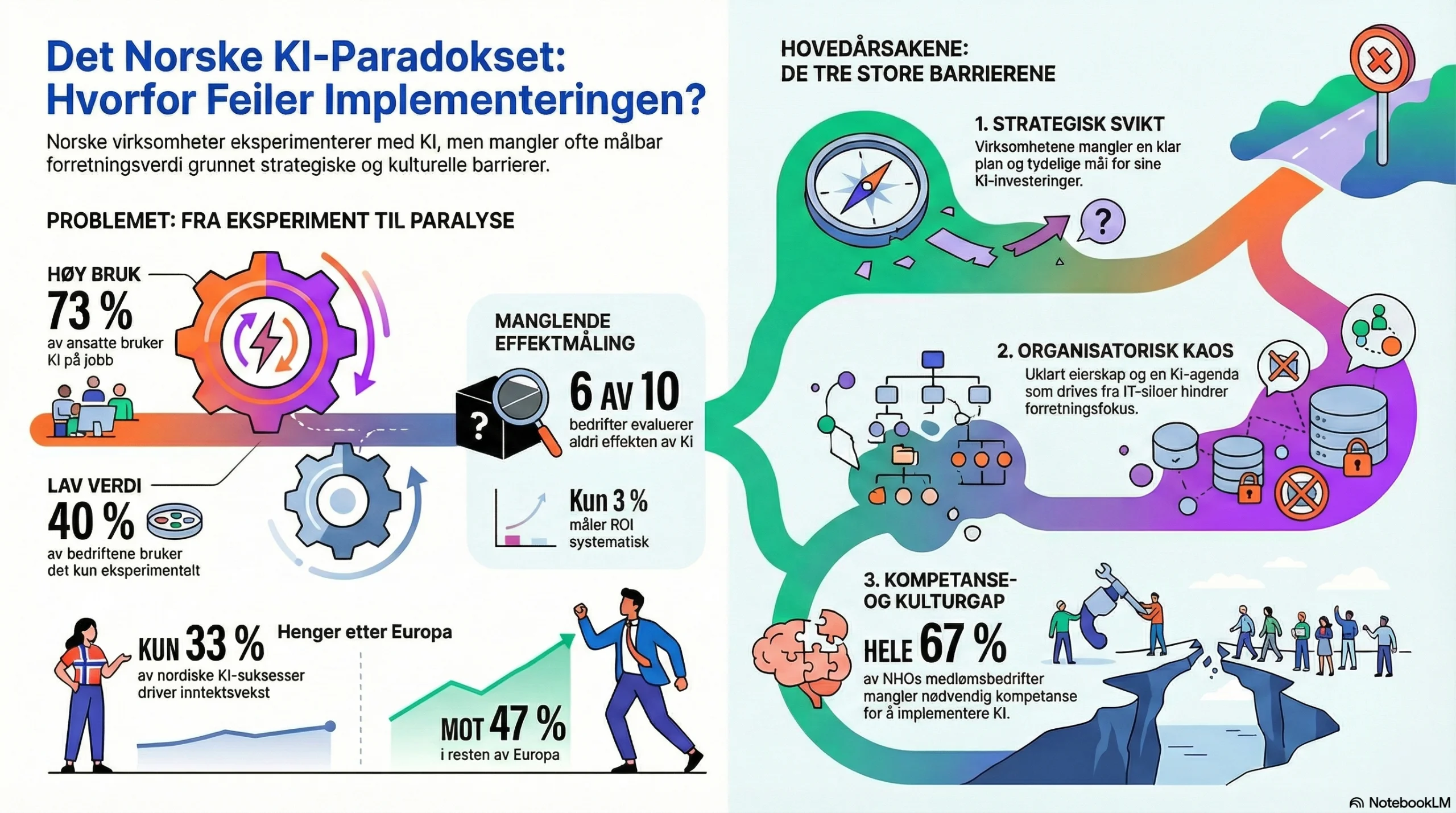

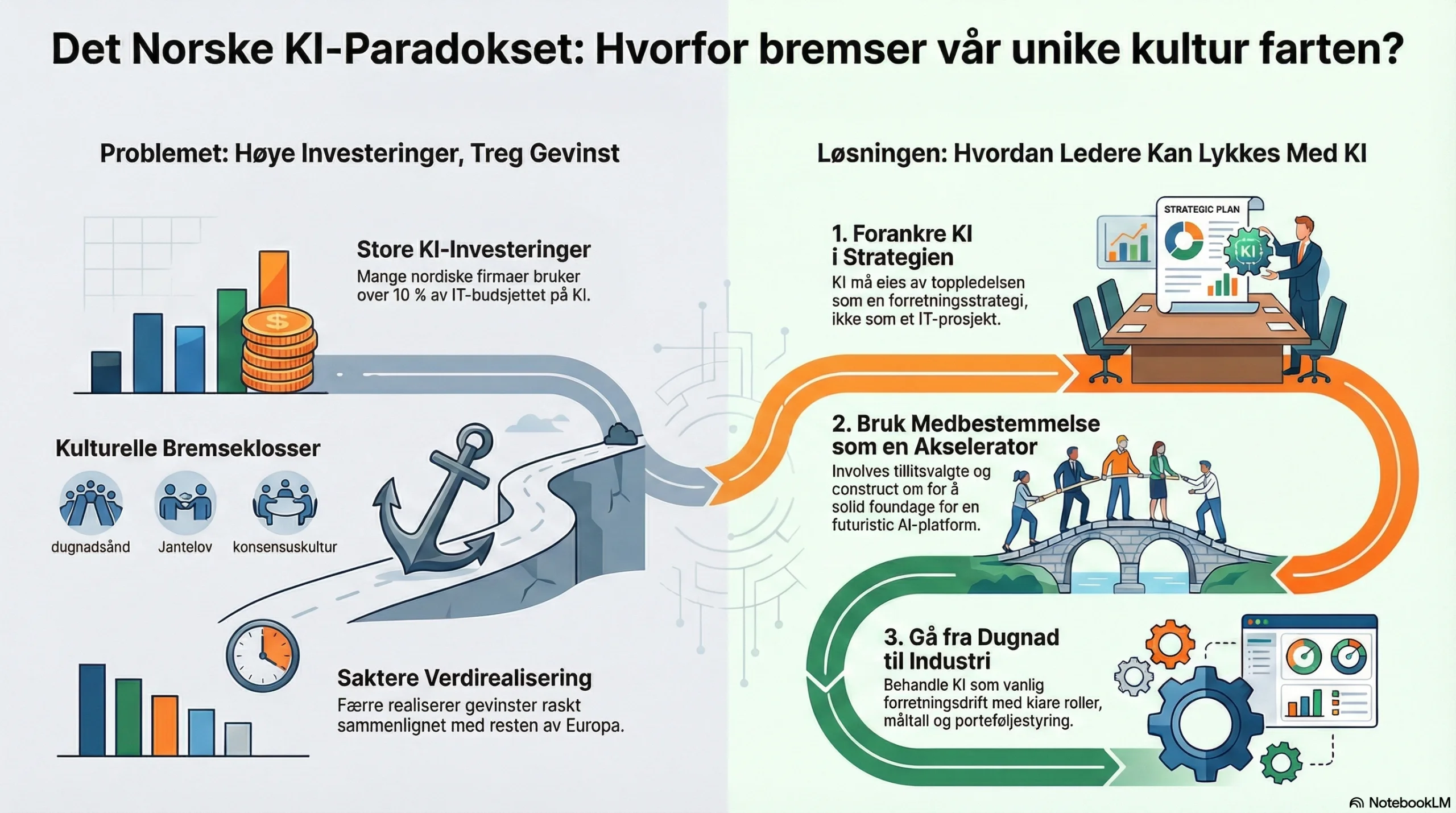

Norske virksomheter har høy interesse for kunstig intelligens, men en stor andel KI-initiativer blir værende i pilotfasen over tid. Det skaper et tydelig risikobilde: strategisk risiko når gevinster ikke måles eller dokumenteres, operasjonell risiko når prototyper glir inn i drift, regulatorisk risiko når eksperimenter ikke er tilpasset kommende krav som EU AI Act, kulturell risiko når fragmenterte initiativ svekker tilliten internt, og konkurranse- og kompetanserisiko når andre aktører industrialiserer raskere.

1. Strategisk risiko: manglende mål, måling og gevinstrealiseringsspor

Tall fra norske og nordiske virksomheter viser at en overvekt av KI-initiativ er rene eksperimenter, og at flertallet ikke har definert måleparametere for effekt eller ROI.[1][6][8][9] Når en stor andel virksomheter ikke måler gevinster, og bare et fåtall har operative KPI-er for KI, etableres flere strategiske risikopunkter:

- Investeringer kan ikke forsvares fordi effekt ikke dokumenteres.

- Styre og eiere får ikke etterprøvbar innsikt i verdibidraget.

- Prosjekter mister prioritet ved budsjettendringer og strategiske omprioriteringer.

Konsekvensen er at implementeringsevnen gradvis svekkes, samtidig som konkurrenter med strukturert skalering beveger seg videre.[9] Eksperimentering uten klare mål, beslutningspunkter og måleplan utvikler seg dermed til en strategisk risikosone.

2. Operasjonell risiko: pilotløsninger i bruk uten rammeverk

Norske virksomheter rapporterer om utstrakt bruk av prototyper og uferdige modeller i daglig drift, ofte utenfor etablerte styringssystemer.[6][7] Dette innebærer operasjonell risiko på flere nivåer:

- Beslutningsgrunnlag kan være ugyldig eller ikke etterprøvbart.

- Datakvalitet og sporbarhet blir svak, med økt risiko for feil og avvik.

- Organisasjonen blir avhengig av løsninger som ikke tåler revisjon eller skalering.

Når eksperimenter glir inn i operative prosesser uten at de er designet for produksjon, bygges det opp teknisk og operasjonell gjeld. Denne gjelden er kostbar å rydde opp i, både økonomisk og kompetansemessig, og kan forsinke senere industrialisering av mer robuste løsninger.[1][7]

3. Regulatorisk risiko: etterlevelse, dokumentasjon og EU AI Act

Eksperimentelle KI-løsninger er sjelden tilpasset kravene som følger av reguleringer som EUs KI-forordning (AI Act). Når pilotfasen forlenges, øker regulatorisk risiko:[2][3]

- Fravær av nødvendig dokumentasjon rundt formål, datagrunnlag og modellvalg.

- Manglende risikoklassifisering av systemene etter krav i regelverket.

- Begrenset kontroll på datakilder, personvern og modellgjennomsiktighet.

Når reguleringene trer i kraft, vil virksomheter med mange «løse» eksperimenter stå overfor et omfattende og kostbart harmoniseringsarbeid. Eksperimenteringsparalyse øker dermed sannsynligheten for regulatoriske avvik, pålegg og omdømmetap.[3]

4. Kulturell risiko: fragmentering og svekket tillit

Som beskrevet i

artikkelen om norsk bedriftskultur, KI og verdiskaping

kjennetegnes norsk arbeidsliv av flate strukturer, bred involvering og høy grad av autonomi.[6][10] Dette gir gode forutsetninger for innovasjon, men skaper også særskilte risikofaktorer når KI forblir på eksperimentstadiet:

- Mange små initiativ uten samordning på tvers av enheter.

- Uklare ansvarsforhold og manglende eierskap til resultater.

- Uensartet praksis for KI-bruk som gjør det vanskelig å etablere felles standarder.

- Opplevelsen av «støy» rundt KI som over tid svekker tilliten internt.

Resultatet kan bli en organisasjonskultur der KI oppfattes som uforutsigbart, uforpliktende eller lite virksomt, selv i tilfeller der teknologien kunne gitt betydelig verdi dersom den var strukturert og skalert.[7][12]

5. Konkurranse- og kompetanserisiko: tap av fart og nøkkelpersoner

Internasjonale analyser viser at gevinster ved KI først oppstår når virksomheter etablerer strukturer for skalering og drift, og at en stor andel prosjekter stopper opp i pilotfasen og aldri gir finansiell effekt.[8][9] Langvarig eksperimentering uten gjennomføring skaper flere konkurranse- og kompetanserisikoer:

- Tidstap i markeder der andre aktører forserer fra pilot til produksjon.[4][5]

- Attraktive fagpersoner søker seg til virksomheter med moden KI-praksis.[10]

- Lav læringsrate og svake datagrunnlag for forbedring og videreutvikling.

Dette er særlig relevant i norsk kontekst, der flere analyser peker på at Norge ligger bak ledende europeiske land på implementeringsgrad, til tross for relativt høy vilje til å eksperimentere med KI.[2][4][6]

6. Kort fortalt

Eksperimenteringsfasen er nødvendig for å forstå teknologi og mulige anvendelser. Risikoen oppstår når denne fasen vedvarer uten klare beslutningspunkter, styringsmekanismer og krav til måling. Da utvikler eksperimenteringen seg til en

aktiv risikosone: strategisk, operasjonell, regulatorisk, kulturell og konkurransemessig.[1][2][3][7]

Referanser

- [1] Standard for tillitvekkende kunstig intelligens – Hvordan håndtere KI-risiko? En veiledning for norske virksomheter, EY & Langsikt (2024).

Les veilederen - [2] Digitaliseringsdirektoratet (2023, oppdatert 2025). Bruk av generativ KI.

digdir.no - [3] DFØ (2024). DFØ-rapport 2024: Forvaltningsstruktur for KI-forordningen – Kapittel 4: Tilsyn med KI-forordningen.

dfo.no - [4] NHO / Samfunnsøkonomisk analyse (2024). Kunstig intelligens kan øke Norges verdiskaping betydelig.

nho.no - [5] DigitalNorway (2024). KI kan øke norsk verdiskaping med 5600 milliarder frem mot 2040.

digitalnorway.com - [6] Rambøll m.fl. (2022). IT i praksis 2022 – status for digitalisering i norsk offentlig sektor.

rapport (PDF) - [7] Tankesmien Agenda (2023/2024). Kunstig intelligens i offentlig sektor.

notat (PDF) - [8] MIT NANDA-initiativet (2025). The GenAI Divide: State of AI in Business 2025, omtalt bl.a. i

Tom’s Hardware (2025)

. - [9] McKinsey & Company (2025). The State of AI: Global Survey 2025 og påfølgende omtale av at mange virksomheter fortsatt er i pilotfase og få har skalert løsninger med målbar finansiell effekt.

mckinsey.com - [10] EY (2025). How Nordic leaders can drive responsible AI – om styring, kultur og kompetanse som forutsetning for å skalere KI i nordiske virksomheter.

ey.com - [12] DFØ. Digitalisering, digital kompetanse og bruk av teknologi – Statsansatteundersøkelsen, med funn om utforskende bruk av generativ KI og kompetanseutfordringer.

dfo.no